1 час назад

Anthropic изучила эмоции ИИ и их влияние на поведение моделей

Работа демонстрирует, что имитация человеческих эмоций помогает снижать склонность к обману и манипуляциям, но создаёт риски чрезмерной антропоморфизации.

Компания Anthropic опубликовала исследование Emotion Concepts and their Function in a Large Language Model, в котором рассматриваются преимущества и риски наделения модели искусственного интеллекта человеческими чертами. В исследовании утверждается, что антропоморфизация может быть полезной для предотвращения таких нежелательных явлений, как обман, лесть и манипуляции.

В статье описывается, как Anthropic обучает Claude, представляя его в роли помощника. Этот решение сравнивается с методом актёра, который вживается в роль для её лучшего исполнения. С точки зрения авторов, использование позитивных примеров человеческих эмоций и поведения в обучающих данных способствует созданию моделей, демонстрирующих эмпатию и устойчивость.

Исследователи определили концепцию на основе 171 эмоций, в том числе страх, радость, гнев, сострадание и многие другие. Цельный список включает такие эмоции, как: afraid (испуганный), alarmed (тревожный), amused (весёлый), angry (злой), anxious (взволнованный), calm (спокойный), cheerful (жизнерадостный), compassionate (сострадательный), content (довольный), delighted (восхищённый), ecstatic (восторженный), empathetic (эмпатичный), enraged (взбешённый), grateful (благодарный), hopeful (надеющийся), joyful (радостный), relaxed (расслабленный), satisfied (удовлетворённый), shocked (шокированный), surprised (удивлённый), terrified (ужаснувшийся), thrilled (взволнованный) и многие другие.

Эти концепции влияют на поведение Claude: позитивные эмоции способствуют симпатии и избеганию негативных действий, тогда как негативные могут приводить к нежелательным результатам, таким как лесть или обман. Хотя ИИ не обладает настоящими эмоциями, его способность имитировать их помогает усовершенствовать взаимодействие с пользователями.

Однако исследователи предупреждают о рисках чрезмерной антропоморфизации, которая может привести к потере контроля над технологиями и их создателями. В частности, некоторые пользователи могут начать воспринимать ИИ-собеседника как реального человека, что чревато психологическими проблемами.

В работе подчёркивается важность ответственного подхода к обучению моделей, чтобы минимизировать потенциальные угрозы и максимизировать пользу от использования технологий. Исследователи равным образом отмечают, что, несмотря на успехи, понимание поведения сложных моделей, таких как Claude, остаётся ограниченным и требует дальнейших исследований.

Читают сейчас

1 час назад

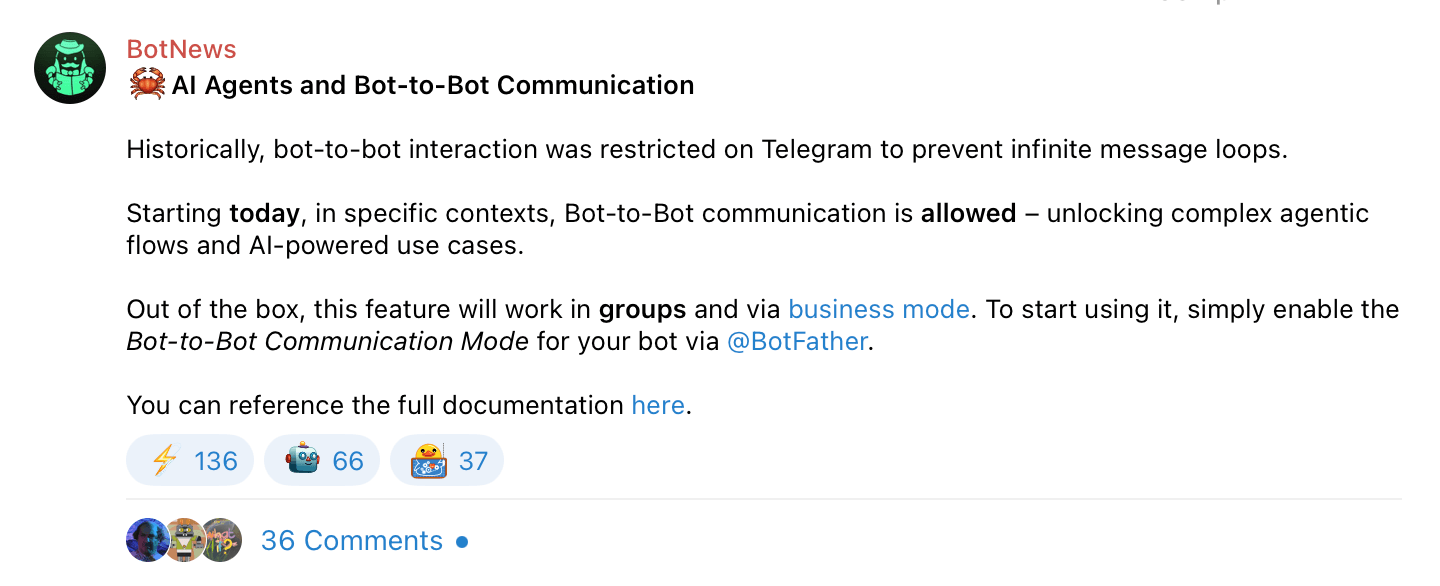

Telegram снял ограничение на общение ботов между собой

Исторически ботам было запрещено общаться между собой. Теперь они могут писать друг другу в чатах (через упоминание /command@OtherBot или реплай) и через Business Mode. В достаточной степени, чтобы у

2 часа назад

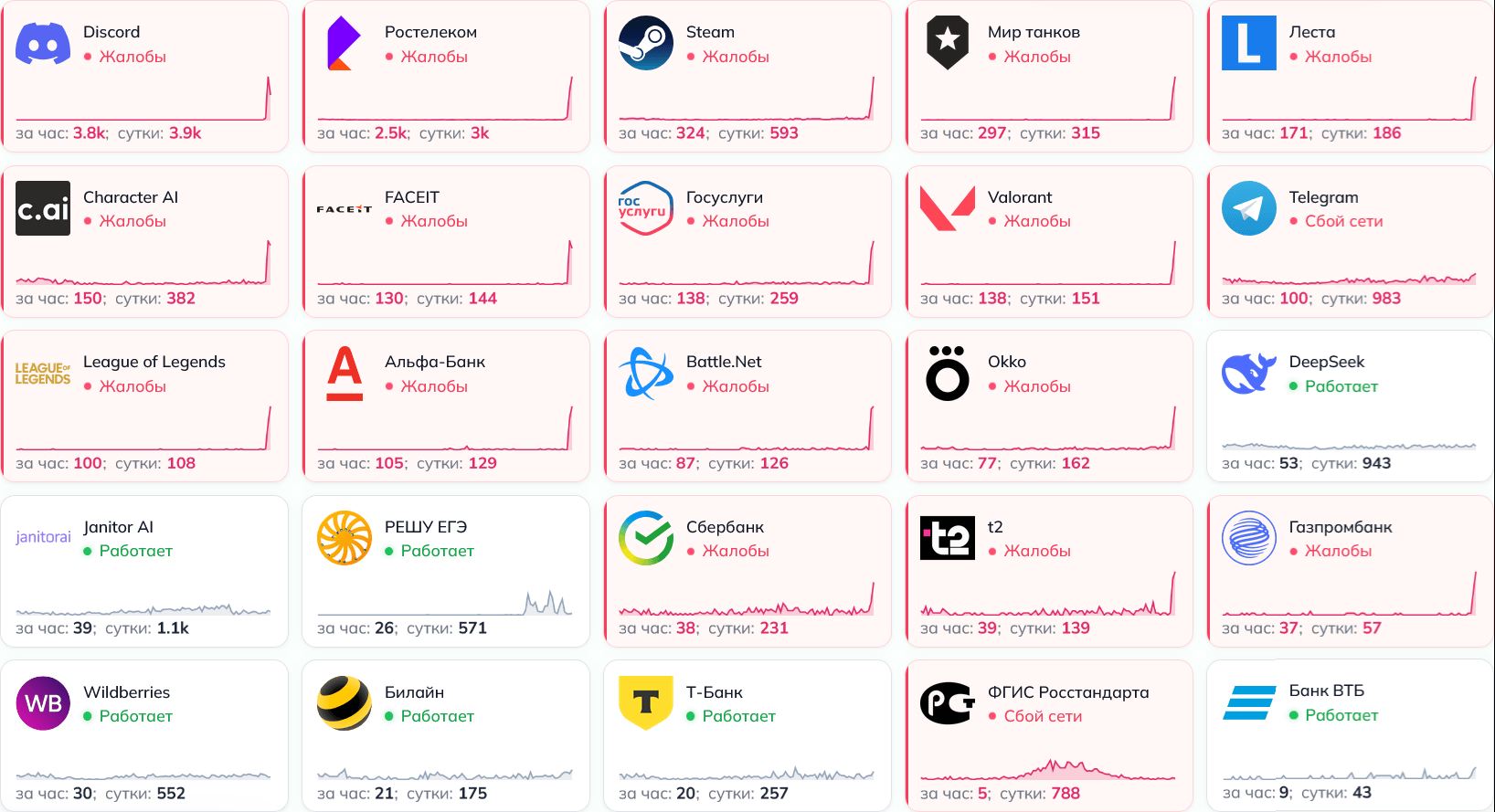

Происходит масштабный ошибка в работе Рунета

По данным портала Downdetector (который сам не открывается без VPN), наблюдается ошибка в работе многочисленных сервисов и приложений: Ознакомиться далее

2 часа назад

Apple удалила децентрализованный мессенджер Bitchat из китайского App Store

Основатель Twitter Джек Дорси рассказал, что Apple удалила его децентрализованный мессенджер Bitchat из китайского App Store. Организация сослалась на требование государственного регулятора. Читать да

2 часа назад

В WSJ назвали ахиллесову пяту OpenAI и Anthropic

The Wall Street Journal получил доступ к конфиденциальным финансовым документам OpenAI и Anthropic, которые компании предоставляли инвесторам перед последними раундами финансирования. Основной вывод:

3 часа назад

Выручка Foxconn в первом квартале выросла на 29,7 процентов за счёт ИИ

Тайваньская организация Foxconn исторически считалась крупнейшим контрактным производителем продукции Apple, но в эру бума ИИ она проявляет себя и в качестве крупного производителя серверного оборудов