7 марта 2026, 13:46

ИИ, который обучается вдвое быстрее: Ai2 выложила в публичный доступ Olmo Hybrid

Некоммерческий исследовательский институт Ai2 (Allen Institute for AI) выпустил Olmo Hybrid — языковую модель на 7 млрд параметров, которая в контролируемом эксперименте показала двукратное преимущество по эффективности обучения перед классическим трансформером. На бенчмарке MMLU модель достигает той же точности, что и трансформер Olmo 3, используя на 49% меньше токенов обучающей выборки. Все веса, исходник, промежуточные чекпоинты и технический отчет опубликованы под лицензией Apache 2.0.

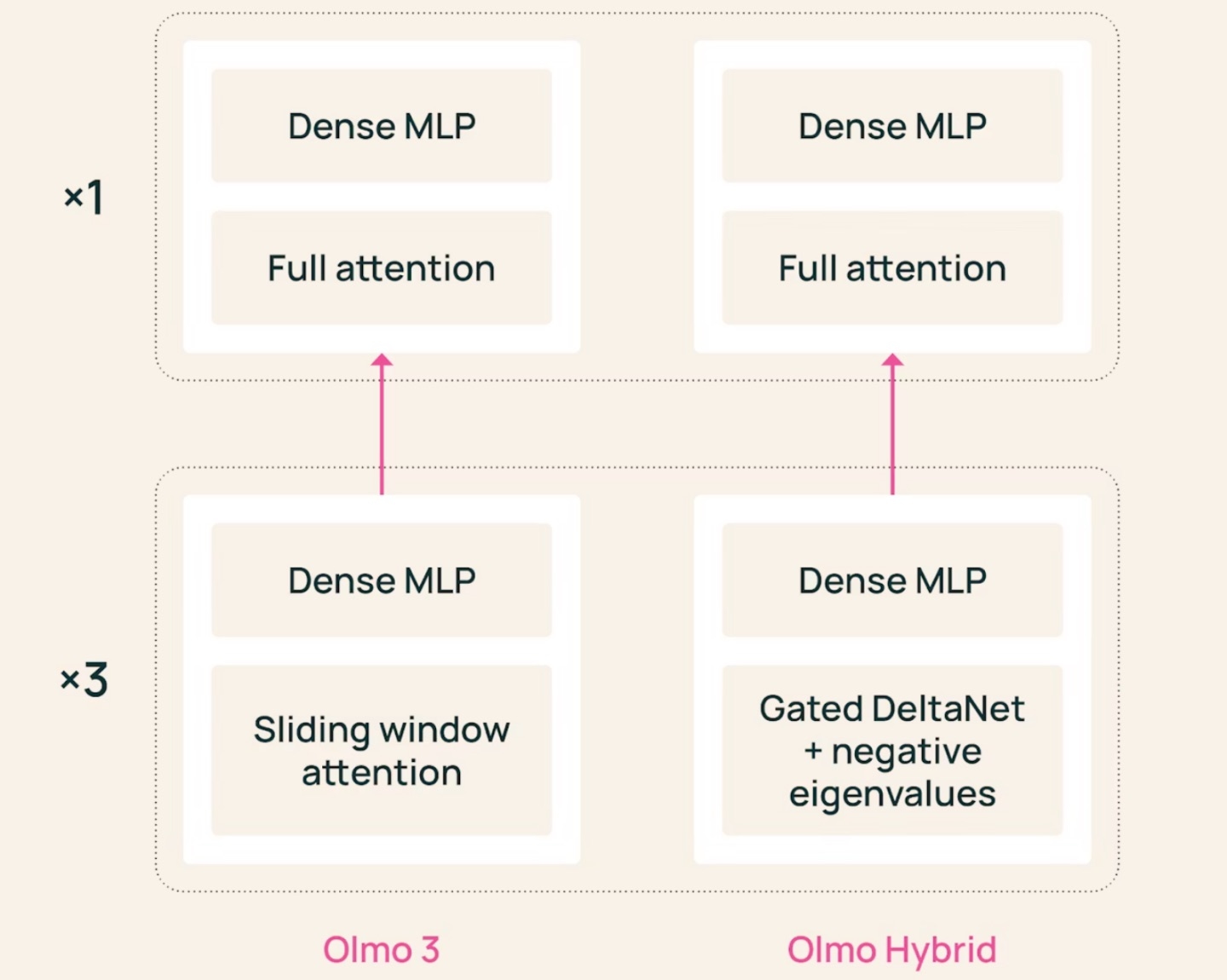

Суть архитектуры — в замене 75% слоев внимания на слои Gated DeltaNet, актуальный вариант линейной рекуррентной сети. Трансформер хорошо извлекает конкретные факты из контекста, но плохо отслеживает изменяющееся состояние — например, позицию фигур на шахматной доске после серии ходов. Рекуррентные слои, наоборот, хранят сжатое "состояние" последовательности и обновляют его с каждым токеном. Гибрид берет лучшее от обеих архитектур: каждый четвертый слой остается трансформерным для точного извлечения информации, а остальные три — рекуррентные для эффективного отслеживания контекста. Эксперименты по скейлингу уже подтвердили, что преимущество сохраняется при увеличении размера модели и объёма вычислений.

Модель обучалась на 6 трлн токенов на кластере из 512 GPU Nvidia Blackwell. Помимо эффективности обучения, Olmo Hybrid показывает на 75% лучший throughput и потребление памяти при инференсе на длинных контекстах — прямое следствие линейного (а не квадратичного) масштабирования рекуррентных слоев. Впрочем, при пост-обучении результаты оказались неоднозначными: схема выиграла у Olmo 3 на задачах знаний, но проиграла на задачах длинных рассуждений. Натан Ламберт из Ai2 признал, что рецепты пост-обучения, отлаженные для трансформеров, не переносятся на гибриды автоматически.

Olmo Hybrid — не единичный эксперимент, а часть нарастающего тренда. Kimi Linear, Nvidia Nemotron-H и IBM Granite 4 — все перешли на гибридные архитектуры в последние месяцы. Разница в том, что Ai2 — единственные, кто выложил не только веса, но и весь стек: данные, исходник обучения, промежуточные чекпоинты и подробный теоретический отчет. Для исследователей, которые хотят понять, почему гибриды работают (а не просто применять чужую схема), это пока лучший доступный артефакт.

P.S. Поддержать меня можно подпиской на канал "сбежавшая нейросеть", где я рассказываю про ИИ с творческой стороны.

Читают сейчас

52 минуты назад

Китайский разработчик роботов UBTech Robotics готов платить $18 млн в год главному учёному по робототехнике

Китайская компания-разработчик человекоподобных роботов UBTech Robotics ищет главного учёного по робототехнике, предлагая зарплату до $18 млн в год. Компания указывает, что эта должность будет определ

59 минут назад

Claude смог запустить промышленный CPU Intel на обычной материнской плате — ИИ полностью переписал BIOS

Моддер с форума Overclock.net с помощью Claude целиком переписал BIOS материнской платы ASUS Z790 и загрузил Windows 11 на серверном 12-ядерном процессоре Intel Bartlett Lake Core 9 273PQE, который In

1 час назад

В OpenClaw за полтора месяца нашли шесть дыр в одном модуле. И это не конец

В подсистеме подключения устройств OpenClaw — ИИ-агента с 348 000 звезд на GitHub — за шесть недель обнаружили шесть уязвимостей класса CWE-863 (некорректная авторизация). Последняя, CVE-2026-33579 с

1 час назад

В Steam тестируют аналитика FPS на конкретном ПК до покупки игры пользователем

Valve тестирует в Steam средство для анализа FPS на конкретном ПК до покупки игры пользователем, сообщил датамайнер dex3108 на форуме ResetEra, обнаруживший строки кода этой функции. Сама организация

2 часа назад

Microsoft вложит $10 млрд в японские ИИ-проекты

До 2029 года Microsoft планирует инвестировать $10 млрд в инфраструктуру искусственного интеллекта и облачных вычислений Японии, пишет местное информационное агентство Kyodo News со ссылкой на вице-пр