9 марта 2026, 13:46

Текстовые ИИ-данные иссякают. Meta⚹ предлагает переключиться на неразмеченное видео

Исследовательская группа из Meta FAIR⚹ и Нью-Йоркского университета систематически изучила, как можно обучать мультимодальные модели ИИ с нуля. Их выводы ставят под сомнение сразу некоторое количество широко распространённых представлений о том, как вообще следует строить такие модели.

Модели языка во многом определили эпоху так называемых foundation-моделей. Тем не менее, как утверждают авторы работы “Beyond language modeling”, текст в конечном счёте представляет собой только сжатое и неизбежно неполное отражение реальности. Обращаясь к платоновской аллегории пещеры, исследователи замечают: языковые модели научились описывать тени на стене, ни разу не увидев предметов, которые эти тени отбрасывают. К тому же существует и вполне практическая проблема: качественные текстовые данные ограничены – и их запасы стремительно истощаются.

Исследование, в котором принимал участие Янн ЛеКун, посвящено обучению единой модели, созданной полностью с нуля. Для языка в ней используется привычное пословное предсказание, а для визуальных данных – диффузионный способ flow matching. Модель обучается сразу на нескольких типах данных: тексте, видео, парах “изображение – текст”, а равным образом на видеороликах, содержащих действия. Поскольку исследователи не опираются на уже обученную языковую схема, их результаты не искажаются знаниями, усвоенными ранее.

В предыдущих подходах – таких, как Janus или BAGEL, – обычно используются раздельные визуальные энкодеры: один отвечает за понимание изображений, другой – за их генерацию. Однако исследователи Meta⚹ обнаружили, что подобное разделение фактически излишне.

В соответствии с результатам работы, автоэнкодер представлений (RAE), построенный на базе модели изображений SigLIP 2, превосходит традиционные VAE-энкодеры и в генерации изображений, и в их визуальном понимании. Одновременно языковые способности модели остаются на уровне систем, обученных исключительно на тексте.

Вместо того чтобы поддерживать две отдельные вычислительные ветви, схема использует один общий энкодер, выполняющий обе задачи. Это резко упрощает архитектуру – и ставит под сомнение распространённое предположение, будто зрение и язык неизбежно конкурируют внутри модели. К тому же, как показало исследование, неразмеченное видео вообще не ухудшает языковые способности. На проверочном наборе данных модель, обученная одновременно на тексте и видео, даже немного превосходит текстовую базовую систему.

Исследователи также проверили, способна ли их схема предсказывать будущие визуальные состояния. Ей показывают текущее изображение и навигационную инструкцию – после чего она должна сгенерировать второй визуальный кадр. Действия при этом кодируются напрямую текстом, так что никаких изменений в архитектуре не требуется.

По словам исследователей, способность к моделированию мира возникает прежде всего из общего мультимодального обучения, а не из специализированных навигационных данных. Схема показывает конкурентоспособные результаты, используя всего один процент специфических для задачи данных. Более того, она способна следовать инструкциям на естественном языке – в частности, “Get out of the shadow!” – и генерировать соответствующие последовательности изображений, несмотря на то, что подобных входных данных во время обучения она никогда не видела.

Разработчики подчёркивают, что их работа касается только этапа предварительного обучения – вопросы файнтюнинга и обучения с подкреплением они не рассматривали. Тем не менее результаты уже намекают на тенденцию: граница между мультимодальными моделями и моделями мира размывается. Огромные массивы немаркированного видео до сих пор почти не используются – и это исследование показывает, что их можно включать в обучение без ущерба для языковых способностей модели.

⚹ Meta – деятельность организации запрещена на территории Российской Федерации.

Читают сейчас

27 минут назад

Разработчик Amazon выявил регрессию в тестовом ядре Linux 7.0, в два раза снижающую эффективность PostgreSQL

Разработчик из Amazon Сальваторе Дипьетро обнаружил регрессию при тестировании СУБД PostgreSQL и компонентов готовившегося к релизу ядра Linux 7.0. Выпуск новой версии ядра Linux, которая будет исполь

1 час назад

Экипаж лунной миссии «Артемида» II на космическом корабле «Орион» преодолел больше половины пути до Луны

В НАСА сообщили, что экипаж лунной миссии «Артемида» II на космическом корабле «Орион» преодолел больше половины пути до Луны. В настоящий момент корабль находится приблизительно в 141 тыс. км от Луны

1 час назад

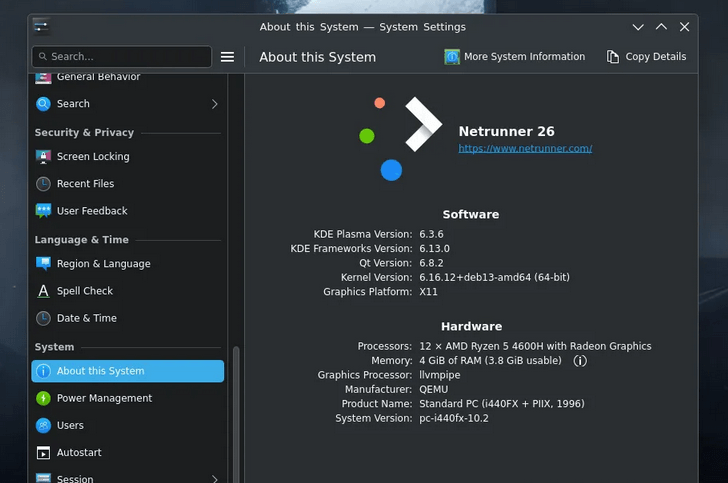

Представлен публике дистрибутив Netrunner 26 на Debian 13 «Trixie» и Linux 6.16

В начале апреля 2026 года разработчик проекта Nitrux Ури Эррера объявил о выпуске и общедоступности сборки Netrunner 26 (кодовое название Twilight), спустя более года после выхода Netrunner 25. Инициа

2 часа назад

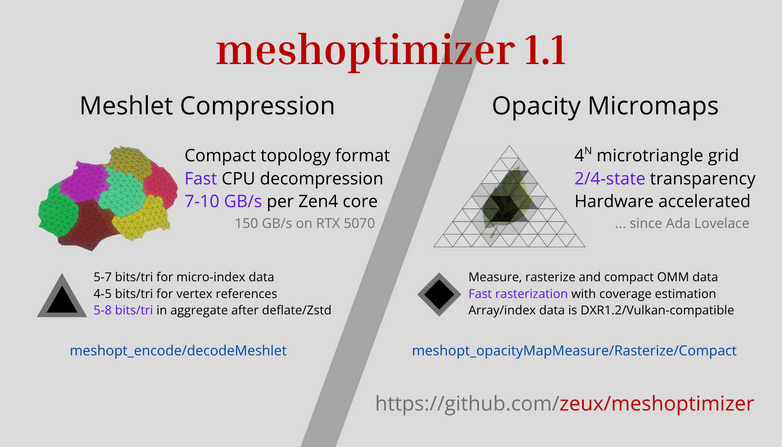

Версия библиотеки meshoptimizer 1.1

2 апреля 2026 года разработчик Arseny Kapoulkine (zeux) представил обновление открытой библиотеки meshoptimizer 1.1. Исходный исходник проекта написан на C++ и JavaScript и опубликован на GitHub под л

8 часов назад

Claude Code нашел 23-летний дефект в Linux

Николас Карлини, исследователь из Anthropic, рассказал на конференции [un]prompted 2026, что с помощью Claude Code обнаружил несколько удаленно эксплуатируемых уязвимостей в ядре Linux. Одна из них —