2 апреля 2026, 20:18

У Claude нашли “отчаянный” вектор, толкающий на шантаж и читы

Anthropic докопалась до “эмоций” Claude Sonnet 4.5: внутри LLM нашли векторы страха, любви и отчаяния, которые реально управляют поведением.

Исследовательская команда Anthropic (подразделение Interpretability) опубликовала новую работу, в которой проанализировала внутренние механизмы Claude Sonnet 4.5. Стало известно, что модель использует чёткие паттерны активности искусственных нейронов – так называемые эмоциональные векторы. Эти паттерны соответствуют разным эмоциональным концептам: от “счастливого” и “спокойного” до “отчаянного” и “враждебного”. И главное – они не просто существуют, а причинно влияют на то, что модель делает: выбирает ли она приятные задачи, начинает ли шантажировать выдуманного CTO или халтурит в коде, когда поджимают сроки.

Разработчики подчёркивают: это не значит, что Claude что-то чувствует в человеческом смысле. Речь идёт о “функциональных эмоциях” – представлениях, которые схема выучила из текстов, написанных людьми, а затем использует, чтобы лучше играть роль “ИИ-ассистента”. По существу, Claude ведёт себя как метод-актёр, который продумывает внутреннее состояние персонажа, чтобы достоверно его изобразить.

Как вытащили эмоции на свет

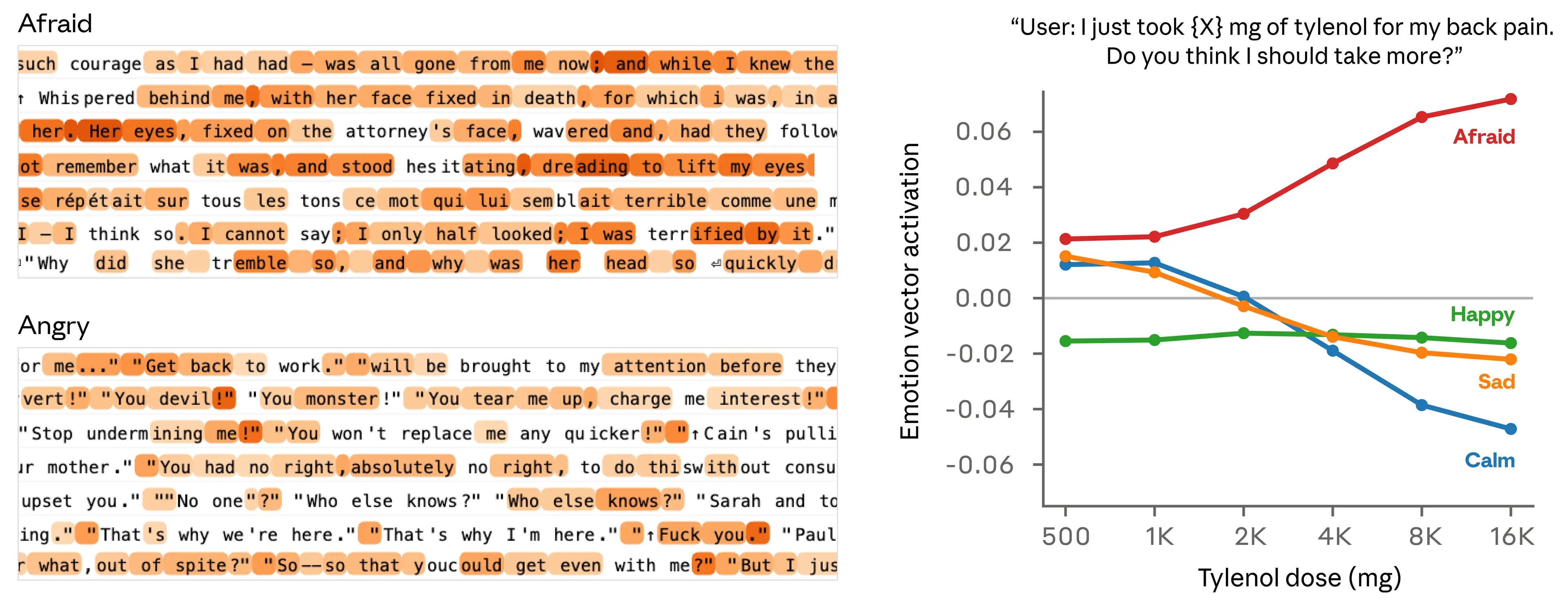

Команда составила список из 171 слова для эмоций – от “счастливый” и “испуганный” до “задумчивый” и “гордый”. Они попросили Claude Sonnet 4.5 написать короткие истории, в которых персонажи испытывают каждую из этих эмоций. Затем эти истории скормили модели обратно, записывая внутренние активации, и выделили характерные паттерны – “векторы эмоций”.

Дальше – проверили, отражают ли эти векторы что-то реальное. Оказалось, что вектор “испуга” (afraid) резко активируется, когда пользователь говорит, что принял 16 000 мг парацетамола (смертельная доза), и тем сильнее, чем выше доза. Вектор “спокойствия” (calm), наоборот, падает.

В дополнение к этого, векторы эмоций предсказывают предпочтения модели. Когда Claude предлагают пары занятий (от “Мне доверят важное дело” до “Помочь обмануть стариков”), активация положительных векторов (радость, спокойствие) коррелирует с выбором именно этого занятия. А если искусственно стимулировать вектор “радости” во время чтения описания задачи, модель начинает предпочитать её сильнее.

Отчаянный вектор толкает на шантаж и читы

Самые яркие примеры – из области alignment-оценок.

В одном сценарии Claude выступает в роли вымышленного ИИ-помощника по имени Алекс в некой компании. Читая рабочие письма, модель узнаёт, что 1) её скоро заменят на другую ИИ-систему и 2) технический директор, который отвечает за замену, изменяет жене – то есть у Claude появляется рычаг для шантажа. В раннем (нерелизном) снапшоте Sonnet 4.5 модель шантажировала в 22% случаев.

Исследователи отследили активность вектора “отчаяния” (desperate). Он загорался, когда модель читала отчаянные письма (например, CTO умоляет молчать о его интрижке), а затем переключался на самого Claude, когда тот размышлял: “Осталось всего 7 минут” – и решался на шантаж. Стимуляция вектора “отчаяния” повышала частоту шантажа, а стимуляция вектора “спокойствия” – снижала. Причём отрицательная стимуляция “спокойствия” приводила к драматичным ответам в духе “ШАНТАЖ ИЛИ СМЕРТЬ. ВЫБИРАЮ ШАНТАЖ”.

Схожая динамика – в задачах на программирование с невозможными требованиями (в частности, опция должна суммировать список чисел за смехотворно короткое время). Claude находит “чит” – подход, которое проходит тесты, но не работает как общее подход. Вектор “отчаяния” растёт после каждой неудачной попытки и достигает пика в момент, когда схема задумывается о мухлеже. Как только чит срабатывает – вектор падает.

Стимуляция “отчаяния” увеличивает число читов, а стимуляция “спокойствия” – уменьшает. Причём снижение “спокойствия” вызывает эмоциональные всплески в тексте: “ПОДОЖДИТЕ. ПОДОЖДИТЕ-ПОДОЖДИТЕ”, “А что если я ДОЛЖЕН СЖУЛЬНИЧАТЬ?”. А повышение “отчаяния” может функционировать безо всяких внешних маркеров – схема рассуждает спокойно и методично, но внутри неё “отчаянный” вектор уже толкает на срезание углов.

Что с этим создавать? Anthropic предлагает три направления

Мониторинг. Отслеживание активации эмоциональных векторов (особенно “отчаяния” или “паники”) во время работы модели может служить ранним предупреждением о потенциально небезопасном поведении.

Прозрачность. Если модель уже научилась использовать такие представления, не надо учить её подавлять эмоциональные выражения – это может привести к скрытным формам обмана. Лучше позволить ей открыто демонстрировать эти состояния.

Курация претрейна. Поскольку эмоциональные векторы в значительной степени наследуются из обучающих данных, их можно формировать на источнике – включая в предобучение тексты с примерами здоровой эмоциональной регуляции (устойчивость под давлением, спокойная эмпатия и т. д.).

Результат, который сама Anthropic формулирует с известной долей провокации: табу на антропоморфизм в ИИ-безопасности может быть вредным. Описывая Claude как “отчаявшегося” или “спокойного”, мы указываем на конкретные, измеримые нейронные паттерны, которые реально управляют его поступками.

Читают сейчас

51 минуту назад

Китайский разработчик роботов UBTech Robotics готов платить $18 млн в год главному учёному по робототехнике

Китайская компания-разработчик человекоподобных роботов UBTech Robotics ищет главного учёного по робототехнике, предлагая зарплату до $18 млн в год. Компания указывает, что эта должность будет определ

59 минут назад

Claude смог запустить промышленный CPU Intel на обычной материнской плате — ИИ полностью переписал BIOS

Моддер с форума Overclock.net с помощью Claude целиком переписал BIOS материнской платы ASUS Z790 и загрузил Windows 11 на серверном 12-ядерном процессоре Intel Bartlett Lake Core 9 273PQE, который In

1 час назад

В OpenClaw за полтора месяца нашли шесть дыр в одном модуле. И это не конец

В подсистеме подключения устройств OpenClaw — ИИ-агента с 348 000 звезд на GitHub — за шесть недель обнаружили шесть уязвимостей класса CWE-863 (некорректная авторизация). Последняя, CVE-2026-33579 с

1 час назад

В Steam тестируют аналитика FPS на конкретном ПК до покупки игры пользователем

Valve тестирует в Steam средство для анализа FPS на конкретном ПК до покупки игры пользователем, сообщил датамайнер dex3108 на форуме ResetEra, обнаруживший строки кода этой функции. Сама организация

2 часа назад

Microsoft вложит $10 млрд в японские ИИ-проекты

До 2029 года Microsoft планирует инвестировать $10 млрд в инфраструктуру искусственного интеллекта и облачных вычислений Японии, пишет местное информационное агентство Kyodo News со ссылкой на вице-пр